Guerre Israël-Palestine : le système d’IA Habsora, « usine d’assassinats de masse »

La guerre d’Israël contre Gaza frappe l’enclave palestinienne avec une férocité meurtrière et sans précédent.

Le ministère de la Santé palestinien a annoncé ce lundi 4 décembre un nouveau bilan de 15 899 morts dans la bande de Gaza, dont 70 % de femmes et d’enfants. Selon l’agence des Nations unies pour les réfugiés de Palestine (UNRWA), près d’1,9 million de personnes ont été déplacées à Gaza depuis le début de la guerre.

Selon de récentes informations, cette charge israélienne est alimentée par un système d’intelligence artificielle (IA). Des experts préviennent que celui-ci est défectueux par essence et n’a aucun sens critique.

Ces responsables ont admis aux médias que les maisons de membres du Hamas et d’autres factions palestiniennes armées avaient été visées à dessein, même si ces frappes impliquaient de tuer tout le monde dans le bâtiment

Dans le cadre d’une enquête conjointe, les médias israéliens +972 Magazine et Local Call ont interviewé plusieurs anciens et actuels officiers des renseignements israéliens qui révèlent que l’armée a abaissé ses attentes concernant la limitation des pertes civiles.

Cet assouplissement des règles se combine avec l’utilisation de « Habsora » (évangile en hébreu), un système d’intelligence artificielle qui peut générer des cibles plus vite qu’avant, ce qu’un officier des renseignements a qualifié d’« usine d’assassinats de masse ».

Ces responsables ont admis aux médias que les maisons de membres du Hamas et d’autres factions palestiniennes armées avaient été visées à dessein, même si ces frappes impliquaient de tuer tout le monde dans le bâtiment.

Par exemple, les renseignements de l’armée israélienne ont approuvé le meurtre de centaines de Palestiniens pour assassiner un seul membre du Hamas.

La quantité, pas la qualité

« C’est la première fois qu’ils évoquent la façon dont les civils sont visés à cette échelle pour ne frapper qu’une seule cible militaire sur la base de la technologie d’IA », commente à Middle East Eye Anwar Mhajne, professeure de sciences politiques au Stonehill College dans le Massachusetts.

À propos du système Habsora, une source a déclaré à la presse israélienne que l’accent était mis sur la quantité, pas sur la qualité. Selon la source, un humain examine les cibles avant chaque attaque mais sans y consacrer beaucoup de temps.

Anwar Mhajne indique : « Si vous menez une guerre de l’ampleur de la guerre actuelle à Gaza, que pouvez-vous vraiment examiner ? »

Un spécialiste israélien de l’utilisation militaire de l’IA, se confiant à MEE sous le couvert de l’anonymat, affirme qu’examiner humainement chaque cible générée par l’IA à Gaza « n’est absolument pas faisable ».

Celui-ci ajoute que l’algorithme n’explique pas comment il parvient à ses conclusions. Il est donc difficile de vérifier la validité du résultat d’une frappe.

Israël estime que Gaza compte environ 30 000 membres du Hamas. Par conséquent, les experts s’inquiètent des lourdes pertes humaines que peut provoquer le fait de compter sur ces systèmes.

L’armée israélienne croit avoir tué entre 1 000 et 2 000 membres du Hamas à Gaza depuis le 7 octobre. Plus de 15 000 Palestiniens ont été tués dans ce laps de temps, parmi lesquels au moins 6 150 enfants.

« On parle de milliers de civils qui ont été tués [en raison de l’utilisation] de cette technologie », fait observer à MEE Mona Shtaya, chercheuse au Tahrir Institute for Middle East Policy, basé à Washington.

L’armée utilise également des caméras qui balaient les visages dans toute la ville « pour aider les soldats aux check-points à identifier les Palestiniens avant même qu’ils présentent leurs cartes d’identité »

Selon la chercheuse, l’utilisation par Israël de l’IA comme outil militaire et de surveillance n’est pas nouvelle, et n’a rien d’inattendu.

« L’IA s’inscrit dans un système de surveillance plus grand, sous lequel les Palestiniens vivent sous surveillance constante », commente-t-elle.

En 2021, une enquête du Washington Post avait révélé que les soldats israéliens utilisaient un programme de reconnaissance faciale généralisé pour améliorer leur surveillance des Palestiniens dans la ville de Hébron, en Cisjordanie occupée.

L’armée utilise également des caméras qui balaient les visages dans toute la ville « pour aider les soldats aux check-points à identifier les Palestiniens avant même qu’ils présentent leurs cartes d’identité ».

La même année, Amazon Web Services et Google ont signé un accord d’1,2 milliard de dollars avec le gouvernement israélien connu sous le nom de projet Nimbus. Les employés de ces deux sociétés ont mis en garde sur le fait que le service cloud « permet une surveillance plus poussée, la collecte illicite de données sur les Palestiniens, et facilite l’expansion des colonies illégales israéliennes sur des terres palestiniennes ».

« Rien n’arrive par accident »

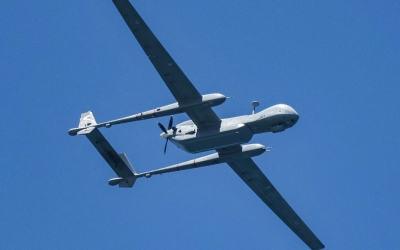

Israël aurait également utilisé l’IA lors de sa précédente offensive majeure contre Gaza en 2021, dans ce qu’elle a appelé « la première guerre par IA au monde ». Au cours des onze jours de bataille, des drones auraient tué des civils, endommagé des écoles et des cliniques, et détruit des tours.

Aujourd’hui, des systèmes plus développés sont employés dans la guerre contre Gaza et vont jusqu’à prévoir le nombre de victimes civiles qu’une frappe provoquerait.

« Rien n’arrive par accident », assure une source à +972 Magazine et Local Call. « Lorsqu’une fillette de 3 ans est tuée dans une maison à Gaza, c’est parce que quelqu’un au sein de l’armé a décidé que sa mort était sans importance, que c’était un prix à payer pour frapper une [autre] cible. Nous ne sommes pas le Hamas. Il ne s’agit pas de roquettes aléatoires. Tout est délibéré. Nous savons exactement quels sont les dommages collatéraux dans chaque maison. »

La guerre actuelle a commencé lorsque des factions palestiniennes menées par le Hamas ont lancé une attaque sur Israël, tuant plus de 1 200 Israéliens et emmenant environ 240 otages. Israël a réagi en bombardement lourdement la bande de Gaza et en envahissant l’enclave côtière, détruisant au passage une grande partie des infrastructures civiles.

Certaines sources de l’enquête disent croire que les tueries et destructions généralisées auraient pu servir à donner une impression de victoire à l’opinion publique israélienne. Anwar Mhajne estime que cet objectif peut être étendu à l’image de la technologie israélienne.

« Les attaques du Hamas ont montré la faiblesse de l’IA en matière de surveillance. »

« Nous ne sommes pas le Hamas. Il ne s’agit pas de roquettes aléatoires. Tout est délibéré. Nous savons exactement quels sont les dommages collatéraux dans chaque maison »

Selon elle, la capacité du Hamas à pénétrer en territoire israélien sans se faire remarquer, une fois que ses combattants eurent démantelé les tours de transmission autour de la bande de Gaza, a gravement nui à la réputation d’Israël .

Les technologies d’espionnage israélienne sont très utilisées dans de nombreux pays pour viser les journalistes et les activistes.

Israël est également le dixième plus grand exportateur d’armes au monde, particulièrement réputé en matière de cybersécurité et d’armes dotées d’IA.

« Ils testent des trucs sur les Palestiniens »

« Ils testent des trucs sur les Palestiniens. C’est pourquoi Israël est un leader en matière de développement de cybersécurité et d’IA, c’est parce qu’ils ont un terrain de test », explique Anwar Mhajne.

« Personne n’aborde avec eux la façon dont ils les développent et les testent. Je vous garantis que cette technologie, après la guerre, sera vendue à tous les régimes répressifs connus. »

Mona Shtaya abonde en son sens, ajoutant que les technologies de guerre par IA sont « utilisées pour impressionner et faciliter leur travail de destruction de la bande de Gaza ».

Si le système reste exclusivement aux mains de l’armée israélienne pour l’instant, les spécialistes israéliens pensent que cela va changer.

« À l’avenir, les gens qui y travaillent rejoindront le secteur privé et développeront des choses similaires et les exporteront, c’est certain », indique-t-il, affirmant que les ventes d’armes israéliennes ont déjà explosé. « Cette guerre est déjà formidable pour les vendeurs et exportateurs d’armes israéliennes. »

Si beaucoup réclament qu’Israël rende compte de ses actes à Gaza, ce qui selon les organismes de l’ONU pourrait mener à des accusations de crimes de guerre et de génocide, lui demander des comptes pour son utilisation de l’IA pourrait être plus compliqué.

Alors que certains gouvernements et organisations internationales régulent l’utilisation de l’IA à des fins militaires en affirmant qu’elle doit rester dans les limites du droit international, il y a peu sinon aucune règle spécifique à l’IA en ce qui concerne la guerre.

« Je vous garantis que cette technologie, après la guerre, sera vendue à tous les régimes répressifs connus »

- Anwar Mhajne, professeure de sciences politiques au Stonehill College dans le Massachusetts

De plus, jusqu’à présent, Israël n’a montré aucun signe de régulation de son utilisation de cette nouvelle technologie, même si cela signifie tuer plus de civils.

« Parce qu’Israël considère désormais le Hamas comme une menace existentielle, il n’y a aucune limite », indique l’expert israélien à MEE, suggérant que le pays pourrait aller jusqu’à tuer des otages israéliens si cela signifie atteindre le haut commandement du Hamas.

« L’IA donne assurément à l’armée l’illusion de la précision et des analyses mathématiques, ce qui est faux », d’après lui. « Tous les défauts humains qu’a appris l’algorithme sont automatiquement présents. »

Le Comité international de la Croix-Rouge est persuadé que l’IA peut être un outil qui permet de prendre de meilleures décisions lors des conflits et aider à éviter les victimes civiles. Mona Shtaya pense également que ces avancées technologiques, utilisées à bon escient, peuvent améliorer de manière générale la qualité de vie de la population.

« Il est douloureux et dévastateur de voir ce type de technologie utilisée par l’État pour opprimer la population et compliquer sa vie, rien que pour infliger des sanctions collectives », conclut Mona Shtaya.

Traduit de l’anglais (original) par VECTranslation et actualisé.

Middle East Eye propose une couverture et une analyse indépendantes et incomparables du Moyen-Orient, de l’Afrique du Nord et d’autres régions du monde. Pour en savoir plus sur la reprise de ce contenu et les frais qui s’appliquent, veuillez remplir ce formulaire [en anglais]. Pour en savoir plus sur MEE, cliquez ici [en anglais].